글의 목적

데이터 분석은 self serving부터 시작한다는 가치관을 가지고 일을 하다 보니 엔지니어링 프레임워크 관심을 두게 되었다. 이런 흐름을 반영하듯 Analytic Engineer 직무가 최근에 국내 기업에도 도입되고 있는 것 같아서 구직활동 겸 공부해본다.

대상독자

- Analytic Engineer에 관심 있는 현직자, 취준생

- 데이터 분야에 흐름이 궁금한 개발/데이터 직군

1. Analytics Engineer(AE) 출현배경

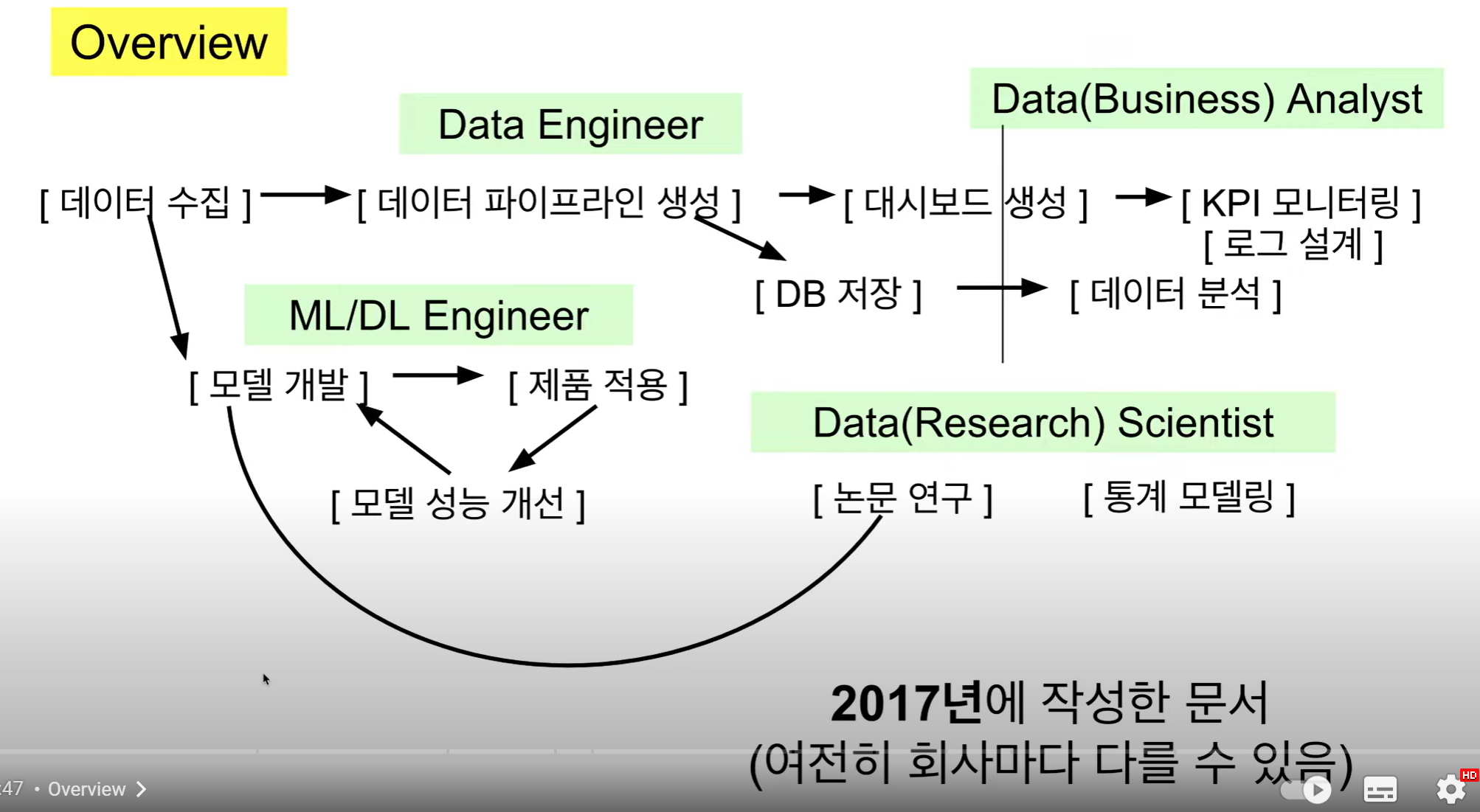

데이터의 저장비용하락과 처리기술의 발전으로 빅데이터 직군이 태동하면서 빅데이터 관련 직무들이 많이 파생되어 가는 것은 잘 알려진 사실이다. 이 부분은 성윤님의 유튜브에서 잘 설명된 장표가 있어서 대체한다.

데이터 산업이 발전함에 따라 기존의 세부직군도 회사에 따라 재정의 되며 나눠지게 되었고 그 대표적인 예가 기존에 데이터분석가가 비즈니스 결정을 돕는 비즈니스분석가와 서비스의 발전을 지향하는 프로덕트 분석가로 나누어진 것 이다.

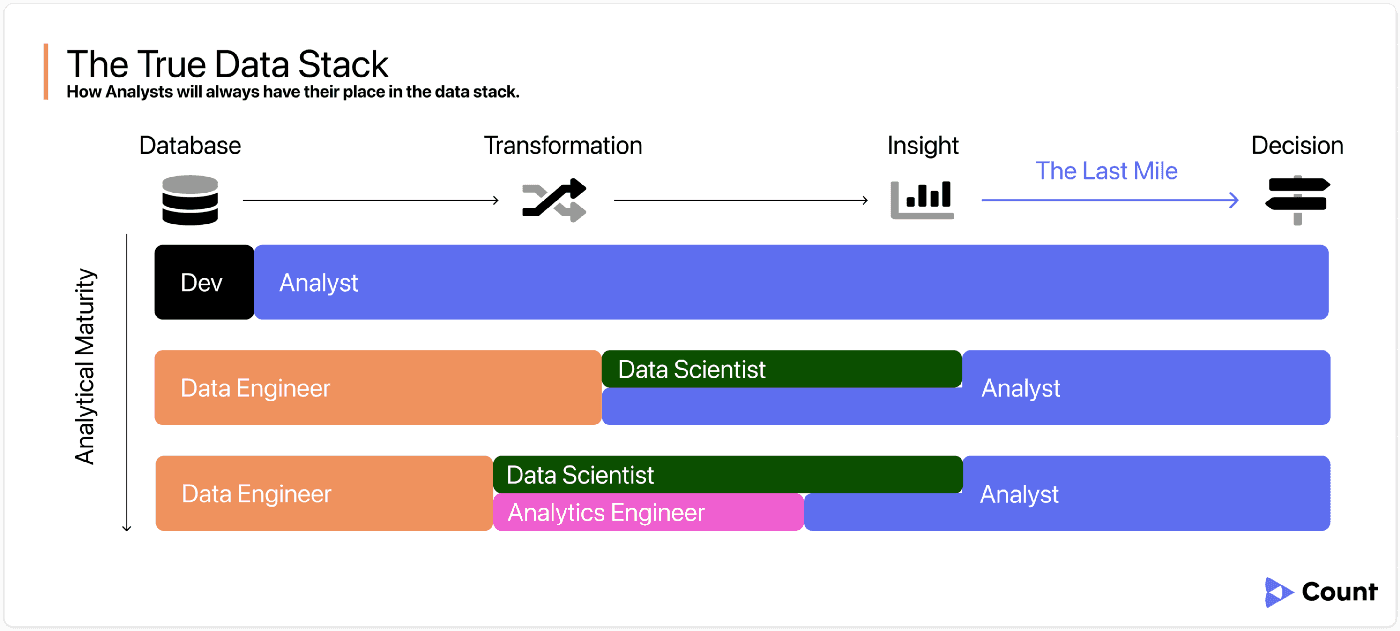

이런 상황에서 데이터 엔지니어와 데이터분석가의 gap을 채워줄 중간자의 역할로 Analytics Engineer가 새로운 직군으로 나타난 것은 비슷한 결의 현상으로 예상할 수 있다. 데이터를 self-serving 하는 역량이 꽤나 중요해졌고 기존 데이터 분석가에게는 실험과 인사이트 발굴에 집중해야 하는 데이터분석가에게는 프로그래밍 역량도 높다고 기대하기 어려우니 그 현실을 반영하는 것 같다.

2. Analytics Engineer 가 해야할 일

이런 출현 배경 속에서 AE가 할일은 당연히 엔지니어링과 데이터 분석 그 어딘가 일 것이다. AE 자체가 직군을 세분화하면서 만들어진 상황이다 보니 데이터 그룹의 성숙도에 영향을 받을 수 있다는 점을 참고하면 좋을 것 같다. 따라서 역할을 깊게 이해하려면 데이터 파이프라인의 맥락 속에서 이해해보려 한다.

① 데이터 처리 및 분석 플랫폼

- 역할: 대규모 데이터 세트의 처리 및 분석을 수행하며, 실시간 및 배치 데이터 처리를 위한 플랫폼을 구축한다. 데이터 처리의 성능과 효율성 향상에 초점

- 기술 스택 예시

1. Hadoop: 대규모 데이터 세트를 처리하고 저장하기 위한 오픈소스 프레임워크로 분산 파일 시스템(HDFS)를 사용하여 데이터를 저장하고 대용량 데이터 처리를 수행

2. Apache Spark: 메모리 기반 분산 컴퓨팅 시스팀. 실시간 처리

② 데이터 모델링 및 웨어하우징

- 역할: 데이터의 구조화 및 조직화, 데이터 웨어하스 내 테이블과 마트 설계, 데이터 적재 조회 분석을 위한 효휼적인 모델링

- 기술 스택 예시

- SQL 데이터베이스: MySQL과 같은 데이터 웨어하우스에서 테이블 설계 및 관리

- 데이터 웨어하우징 솔루션: Amazon RedShift, Snowflake 등 대규모 데이터를 효율적으로 저장하고 분석

③ 데이터 파이프라인 및 오케스트레이션

- 역할: 데이터의 ETL 과정을 관리하고, 다양한 데이터 소스와 시스템의 데이터 흐름 조율, 파이프라인 자동화 및 최적화

- 기술 스택 예시: 데이터 파이프라인 워크플로우 관리 플랫폼 Apache Airflow

3. DE, AE, DA 별 차이 정리

| Data Engineer | Analytic Engineer | Data Analyst | |

| 역할 | - 데이터 인프라 구축 및 유지에 초점 | - 데이터 모델링 및 웨어하우스, 비즈니스 인텔리전스에 초점 - 비즈니스 인사이트, 의사결정에 용이하게 하는 역할 |

- 비즈니스 인사이트, 의사결정 지원 자체에 초점 |

| 기술스택 | - DBMS - 빅데이터 처리 프레임워크(Hadoop, Spark) - 클라우드 서비스 - 데이터 파이프라인 도구(Airflow, Kafka) |

- SQL 및 DBMS - 데이터 웨어하우스 솔루션(Snowflake, Redshift) - 데이터 시각화 도구(Tableau, Looker) - 빅데이터 처리 프레임워크(Hadoop, Spark) - 데이터 파이프라인 도구(Airflow) |

- 데이터 분석 도구 및 언어(SQL, Python, R) - 데이터 시각화 도구(Tableau, Looker) |

| 주요 업무 | - 데이터 저장소 및 파이프라인 구축 및 관리 - ETL 프로세스 관리 |

- 데이터 웨어하우스 및 마트 구축 - 데이터 오케스트레이션 - 시각화 분석을 위한 대시보드 및 보고서 작성 |

- 통계분석, A/B test, 인사이트 제공 |

4. 그래서 공부 뭐해야 함?

결론은 어떻게 입문할까 고민하고 네이버,토스 등 공고를 확인 해보았을 떄 한가지 문장으로 요약될 수 있었다.

DBT, Spark, Airflow, 를 기반으로 한 데이터 파이프라인 개발 지식과 경험

위 성과를 달성하기 위해서 참고해볼만한 컨텐츠를 커뮤너티와 지인들에게 수집해봤는데 아무래도 데이터엔지니어링 관련 과목들 중에 AE의 Job Description에 적용해볼 만한 것을 고르는 게 고민스러웠다. 정리해보자면 다음과 같다.

- 공통: 프로그래머스 데브코스 데이터 엔지니어링

- 공통(책): 빅데이터를 지탱하는 기술

- DBT: The Complete dbt (Data Build Tool) Bootcamp: Zero to Hero

- airflow(책): Apache Airflow 기반의 데이터 파이프라인

- airflow: Marc Lamberti Udemy 강의

5. 마무리

생각보다 오랜만에 기술적인 내용을 파려니까 모호한 단어들과 상상력을 동원해서 이해하기가 힘들었다. 아직도 모호하지만 한편으로는 새로운 세계로 진입하게 되는 것 같다 흥미롭기도 엉덩이가 들썩들썩 ~ 이제 공부하자 !

*이 글을 쓰는데 알짜시간으로는 4시간, calender day로 2일 걸렸습니다.

6. 출처

- 카일스쿨 - 요즘 데이터 분석가의 현실, 데이터 분석 직군의 세분화 트렌드

- Selecting the right tech stack for a data pipeline solution

- PAP - 데이터 잡부, 근데 이제 Analytic Engineering을 곁들인

- What is analytics engineering?

- What Will “Analyst 2.0” Look Like?

7. 글또 9기 글 모음

- 당신은 절대 글을 잘 쓸 수 없다.

- 기호주의와 연결주의로 알아보는 AI의 발전

- 알고리즘은 데이터 분석가에게 필요할까?

- Analytics Engineer 직무 뜯어보기

'Data Science' 카테고리의 다른 글

| [글또]시계열 Prophet 모형과 하이퍼파라미터 뜯어보기 with 주가데이터 (1) | 2024.02.27 |

|---|---|

| [글또] 데이터 분석을 위한 준비하고 배울 것들 (0) | 2024.02.18 |

| [글또] 알고리즘은 데이터 분석가에게 필요할까? (0) | 2024.01.07 |

| [글또] 기호주의와 연결주의로 알아보는 AI 발전 (2) | 2023.12.24 |

| [글또] 당신은 절대 글을 잘 쓸 수 없다 (1) | 2023.12.10 |